平均最近邻算法的秘密武器

引言

“近朱者赤,近墨者黑。”这句话道出了邻近事物之间的密切关联。在机器学习中,平均最近邻(K-Nearest Neighbors,简称KNN)算法同样揭示了这一点。它通过计算数据点之间的距离,找到了解问题的高手——近邻。今天,让我们揭开平均最近邻算法的神秘面纱,一窥其中的奥秘。

一、平均最近邻算法简介

平均最近邻算法,顾名思义,是寻找数据集中距离最近的邻居的一种方法。在这个算法中,我们将每个数据点看作是一个邻居,并根据其与目标数据点的距离进行排序。距离越近,邻居越重要。接着,我们对这些邻居的属性进行平均,得到目标数据点的预测值。

二、平均最近邻算法的秘密武器

1. 距离度量

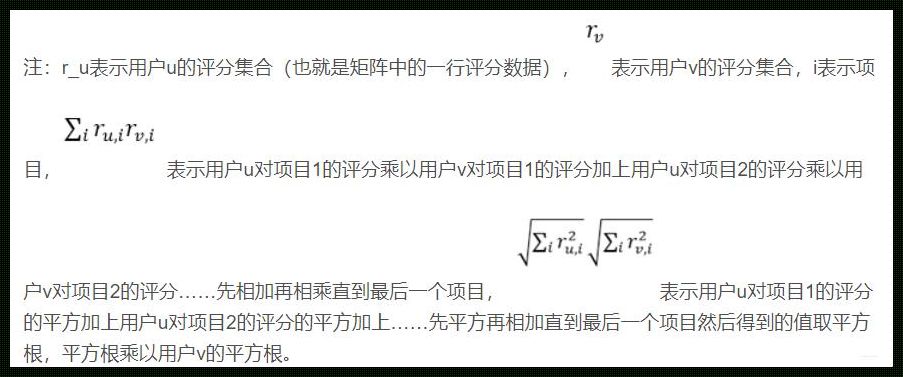

平均最近邻算法中的关键是距离度量。常见的距离度量方法有欧氏距离、曼哈顿距离和余弦相似度等。选择合适的距离度量方法,可以提高算法的准确性。

2. 投票策略

在平均最近邻算法中,我们对邻居的预测结果进行投票,得出最终结果。不同的投票策略有不同的效果。比如,少数服从多数、权重投票等。投票策略的选择,关系到最终预测结果的可靠性。

3. 核函数

当数据集中存在不同尺度的特征时,核函数可以帮助我们将数据映射到同一尺度。这使得算法在处理高维数据时,仍能保持良好的性能。常见的核函数有线性核、多项式核和径向基函数核等。

三、平均最近邻算法的实践与应用

平均最近邻算法在许多领域都有广泛应用,如图像识别、文本分类、异常检测等。以图像识别为例,我们可以通过计算图像特征点的距离,找到相似的图片。在文本分类领域,平均最近邻算法可以用于寻找相似文档,从而实现自动分类。此外,在金融、医疗等领域,平均最近邻算法也发挥着重要作用。

四、结语

平均最近邻算法作为一种简单而有效的机器学习方法,在实际应用中取得了显著的成果。然而,它也存在一定的局限性,如过拟合问题和邻居数量的选取等。未来,随着算法的不断优化和创新,平均最近邻算法在各个领域的应用将更加广泛。

“知己知彼,百战不殆。”了解平均最近邻算法的秘密武器,有助于我们更好地把握算法应用的脉搏。在学习过程中,我们要善于挖掘算法的优点,同时认识到其局限性,从而在实际问题中发挥算法最大的价值。

相关文章

发表评论

评论列表

- 这篇文章还没有收到评论,赶紧来抢沙发吧~